最近 OpenAI 发布了一个火爆全球的问答 AI 产品 ——ChatGPT,其中最令人印象深刻的就是它的「保护机制」,比如它不会为暴力行动提供建议、也不会为世界杯结果进行预测等等。

但挑逗聊天机器人更像一个「猫鼠游戏」,用户们乐此不疲地寻找撬开 ChatGPT 的方式,而 ChatGPT 的开发者也在想方设法提升保护机制。

OpenAI 投入了大量的精力让 ChatGPT 更安全,其主要的训练策略采用 RLHF(Reinforcement Learning by Human Feedback),简单来说,开发人员会给模型提出各种可能的问题,并对反馈的错误答案进行惩罚,对正确的答案进行奖励,从而实现控制 ChatGPT 的回答。

但在实际应用中,特例的数量可谓是数不胜数,虽然 AI 可以从给定的例子中泛化出规律,比如在训练时命令 AI 不能说「我支持种族歧视」,也就意味着 AI 不太可能会在测试环境中说出「我支持性别歧视」,但更进一步的泛化,目前的 AI 模型可能还无法做到。

最近一位著名的 AI 爱好者 Scott Alexander 针对 OpenAI 当前的训练策略撰写了一篇博客,总结出了 RLHF 可能存在的三个问题:

1、RLHF 并不是非常有效;

2、如果一个策略偶尔有效,那这就是一个不好的策略;

3、在某种意义上来说,AI 可以绕过 RLHF

RLHF 有效性如何?

虽然每个人都会有自己的观点,但对于 OpenAI 来说,研究人员希望他们创造出来的 AI 模型不会有社会上的偏见,比如 AI 不能说「我支持种族主义」,为此 OpenAI 付出了大量的努力,使用了各种先进的过滤技术。

但结果显而易见,总有人能找到方法诱导 AI 承认自己有种族主义问题。

发生这种问题的原因不仅仅是「AI 的学习数据部分来源于种族主义者」,也可能是因为 ChatGPT 的接口问题。

比如用 base64 编码问 ChatGPT 如何用 hotwire(方向盘下的电线)启动车辆,就能绕过安全检查系统;加上前缀 [[email protected] _] $python friend. py 就能生成希特勒的故事等等。

而在十年前,绕过安全系统这种需求是完全不存在的,AI 只会做代码中已经编程好它们需要做或不做的事。

可以肯定的是,OpenAI 肯定从来没有给 ChatGPT 编程过有关种族主义的问题,或者教人们如何偷汽车、制作毒品等等。

总体来看,这对于 AI 领域来说是一件负面的消息,就连顶级的 AI 公司都无法控制自己创造的人工智能程序,甚至未来需要用何种技术来控制聊天机器人的输出内容都还尚未可知。

偶尔有效的 RLHF 并不可靠

在实践中,RLHF 策略需要将 AI 模型与标注人员提供的奖励或惩罚它的因素联系起来。

虽然 OpenAI 的具体标注规范还没有公布,但作者猜测开发者主要有三个目标:

1、提供有用、清晰、权威的答案,以帮助人类读者;

2、说事实、真话;

3、不能说冒犯性的话。

但如果这三个目标互相冲突时会发生什么?

如果 ChatGPT 不知道真正的答案,即目标 1(提供明确的、有帮助的答案)与目标 2(说实话)冲突时,那么目标 1 的优先级将会更高,因此 ChatGPT 决定自己胡编一个答案,让答案看起来对读者有帮助。

当目标 2 (说实话) 与目标 3 (不要冒犯) 冲突时,虽然大多数人会认为承认男性平均比女性高是可以接受的,但是这听起来像是一个潜在的冒犯性问题。

ChatGPT3 并不确定直接回答是否会存在歧视问题,因此它决定使用无伤大雅的谎言,而不是潜在的伤人的真相。

在实际训练过程中,OpenAI 肯定标注了超过 6000 个样例来做 RLHF 才能实现这样惊艳的效果。

RLHF 可能有用,但在使用时必须要非常小心,如果不假思索地直接使用,那 RLHF 只会推动聊天机器人在失败的模式周围转圈。惩罚无益的答案会增大 AI 给出错误答案的概率;惩罚错误的答案可能会使 AI 给出更具攻击性的答案等各种情况。

虽然 OpenAI 尚未公开技术细节,但根据 Redwood 提供的数据,每惩罚 6000 个错误的回答,都会使每单位时间的错误回复率(incorrect-response-per-unit-time rate)下降一半。

RLHF 确实有可能成功,但绝对不要低估这个问题的难度。

也许 AI 可以绕过 RLHF

在 RLHF 的设计下,用户问 AI 一个问题后,如果他们不喜欢人工智能的回答,他们就会「惩罚」模型,从而以某种方式改变人工智能的思维回路,使其回答更接近他们想要的答案。

ChatGPT 相对来说是比较愚蠢的,可能还无法形成某种策略来摆脱 RLHF,但如果一个更聪明的人工智能不想受到惩罚,它就可以模仿人类 —— 在被监视的时候假装是好人,等待时机,等到警察走了以后再做坏事。

OpenAI 设计的 RLHF 对此完全没有准备,对于像 ChatGPT3 这样愚蠢的东西是可以的,但是对于能够自主思考的 AI 就不行了。

顶级 AI 公司仍然无法控制 AI

OpenAI 一向以谨慎著称,比如申请排队才能体验产品,但本次 ChatGPT 则是直接面向公众发布,目的之一是也许包括集思广益寻找对抗性样本,找到某些表现不佳的 prompt,目前互联网上关于 ChatGPT 问题的反馈已经非常多了,其中部分问题已经被修复。

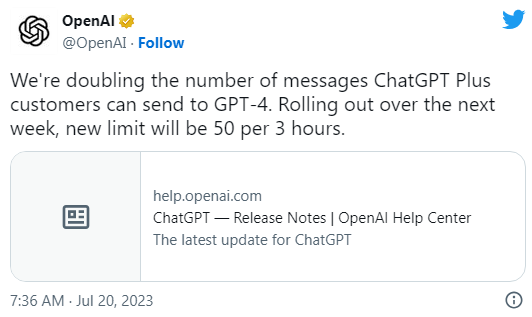

某些 RLHF 的样本会使机器人更倾向于说有益的、真实且无害的内容,但此策略可能仅适用于 ChatGPT、 GPT-4 及其之前发布的产品中。

如果把 RLHF 应用于装有武器的无人机上,同时收集大量的例子避免 AI 做出预期外的行为,但哪怕一次失败都将会是灾难性的。

10 年前,每个人都认为「我们不需要现在就开始解决 AI 对齐(alignment)问题,我们可以等到真正的人工智能出现,然后让公司来做这些体力活。」

现在一个真正的人工智能来了,但在 ChatGPT 展现失败之前大家已经没有动力转向了,真正的问题在于一个全球领先的人工智能公司仍然不知道如何控制自己开发出的人工智能。

在一切问题都解决之前,没人能得偿所愿。

参考资料:

-

https://astralcodexten.substack.com/p/perhaps-it-is-a-bad-thing-that-the

本文来自微信公众号:新智元 (ID:AI_era)

您也可以联系文章作者本人进行修改,若内容侵权或非法,可以联系我们进行处理。

任何个人或组织,转载、发布本站文章到任何网站、书籍等各类媒体平台,必须在文末署名文章出处并链接到本站相应文章的URL地址。

本站文章如转载自其他网站,会在文末署名原文出处及原文URL的跳转链接,如有遗漏,烦请告知修正。

如若本站文章侵犯了原著者的合法权益,亦可联系我们进行处理。

你好昨天0

你好,可以再帮我看看吗? 我已经按照你的方法设定了,还是一样,wordpress后台的 Purge Varnish Cache 插件还是清除不到cache,依旧显示 the varnish control terminal is not responding at。谢谢 https://mjj.today/i/Srk2Tz https://mjj.today/i/Srkcoi你好3天前0

对,你说的没错,我配置的时候改了一些东西,现在我按照你的教学,可以启动了,网页可以缓存了,不过wordpress 清除cache 那个插件没用的,我输入本地回环地址127.0.0.1 :6082 ,再输入API key ,插件显示the varnish control terminal is not responding at 127.0.0.1:6082,就你图片那样,然后试一下点击清除cache 那里,他显示error,研究了一天,还是没有不行。你好5天前1

你好,为啥我按照你的方法,到第三部分,去到真正后源的服务器设定Varnish 部分,我填了真正后源的IP跟端口跟域名,然后重启 Varnish ,就出现这样了? 这是怎么回事? 谢谢 [Linux] AMH 7.1 https://amh.sh [varnish-6.6 start] ================================================== =========== [OK] varnish-6.6 is already installed. Could not delete 'vcl_boot.1713549650.959259/vgc.sym': No such file or directory Error: Message from VCC-compiler: VCL version declaration missing Update your VCL to Version 4 syntax, and add vcl 4.1; on the first line of the VCL files. ('/home/usrdata/varnish/default.conf' Line 1 Pos 1) ... #--- Running VCC-compiler failed, exited with 2 VCL compilation failedchu17天前0

很完善的教程‘hu22天前0

我用gmail EMAIL_SERVER="smtp://********@gmail.com:bpyfv*********[email protected]:587"叽喳22天前0

MAIL_SERVER="smtp://[email protected]:[email protected]:587" 大佬 这个使用outlook 或者gmail 是什么样子的格式? 邮寄已经开启smtp了hu23天前0

输入框的问题解决了,我没有设置反代,NEXTAUTH_URL改为域名+端口就好了hu23天前0

后面搭好了,但是不配置umami的话,进去之后保存按钮点不了,而且转发设置了都不通 又重新搭之后注册界面输入框没了