![图片[1] - Stability AI推出大型语言模型 StableLM - EVLIT](https://imgcache.evlit.com/wp-content/uploads/2023/04/4ba9c4cbc9d4bc70794e3ba598e0ece6.jpg)

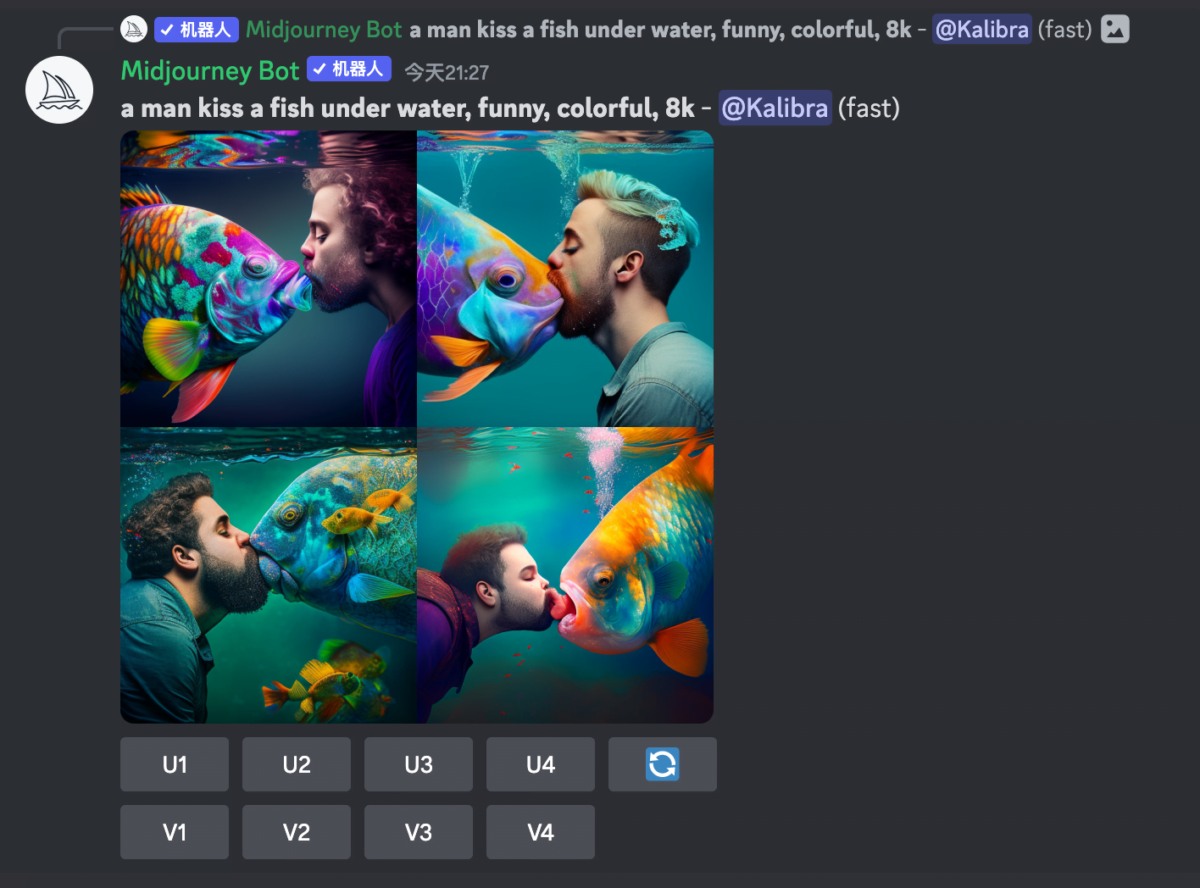

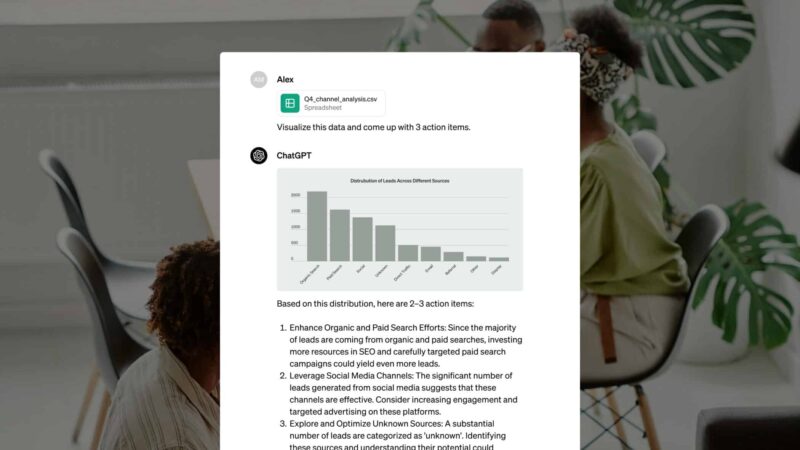

Stability AI近日发布了一种新型的开源语言模型“StableLM”,它是由“The Pile”开源数据集(800GB)训练而成,被认为是OpenAI GPT、Meta LLaMA以及Google LaMDA等文本生成AI系统的竞争对手。模型目前处于Alpha版,提供包括30亿和70亿个参数的两种以供使用(其中70亿模型在 Hugging Face 进行测试)。未来还将发布更大规模的150亿或650亿参数的模型,另外根据CC BY-SA-4.0许可证,所有人都可以自由地将该模型用于商业/研究目的。

StableLM 能够高效地生成文本和代码,并在多个应用场景中得到应用。有意思的是,在适当的训练下,该模型可以表现出优异的性能,在编码和对话任务中展现出非凡的成果,说明即使是小型的模型也能发挥出强大的作用。这对比起其他同类产品而言有很大优势,例如OpenAI GPT-3的参数数达到了175亿,而StableLM只有30亿。

但该模型的表现还不够出色,该公司计划在未来继续发布更多的基于Stability AI技术的模型,并与开发者和研究人员合作推广StableLM Suite。借助于这些新型技术,我们相信AI技术将为更多领域带来革命性的变化。

© 版权声明

本站所有文章,仅代表文章作者个人观点,如对观点有疑义时不用怀疑,您绝对是对的。

您也可以联系文章作者本人进行修改,若内容侵权或非法,可以联系我们进行处理。

任何个人或组织,转载、发布本站文章到任何网站、书籍等各类媒体平台,必须在文末署名文章出处并链接到本站相应文章的URL地址。

本站文章如转载自其他网站,会在文末署名原文出处及原文URL的跳转链接,如有遗漏,烦请告知修正。

如若本站文章侵犯了原著者的合法权益,亦可联系我们进行处理。

您也可以联系文章作者本人进行修改,若内容侵权或非法,可以联系我们进行处理。

任何个人或组织,转载、发布本站文章到任何网站、书籍等各类媒体平台,必须在文末署名文章出处并链接到本站相应文章的URL地址。

本站文章如转载自其他网站,会在文末署名原文出处及原文URL的跳转链接,如有遗漏,烦请告知修正。

如若本站文章侵犯了原著者的合法权益,亦可联系我们进行处理。

THE END

![表情[xiaojiujie] - EVLIT](https://cdn.evlit.com/wp-content/themes/zibll/img/smilies/xiaojiujie.gif)

暂无评论内容