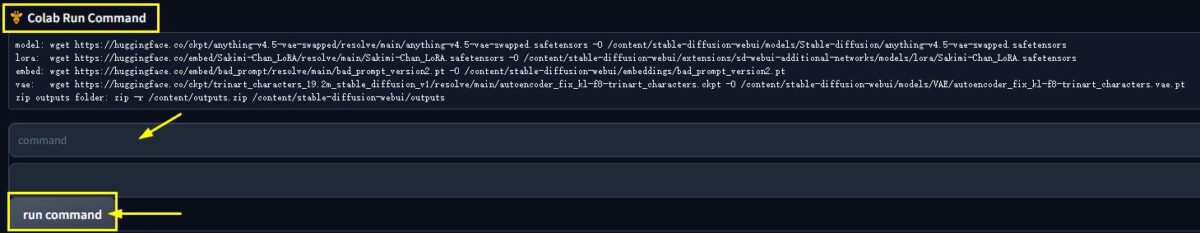

工欲善其事必先利其器,一些常用的模型建议提前下好。colab白piao用户更是如此,强烈建议将常用模型放谷歌盘,C站H站高峰期速度不稳定,往往等上半小时下载。建议先用huggingface下载,使用结束后备份到谷歌盘,下次使用直接拖过来。

基础模型

wget https://huggingface.co/stabilityai/sd-vae-ft-mse-original/resolve/main/vae-ft-mse-840000-ema-pruned.ckpt -O /content/stable-diffusion-webui/models/VAE/vae-ft-mse-840000-ema-pruned.vae.pt

wget https://huggingface.co/Kanbara/doll-likeness-series/resolve/main/japaneseDollLikeness_v15.safetensors -O /content/stable-diffusion-webui/extensions/sd-webui-additional-networks/models/lora/japaneseDollLikeness_v15.safetensors

wget https://huggingface.co/Kanbara/doll-likeness-series/resolve/main/koreanDollLikeness_v15.safetensors -O /content/stable-diffusion-webui/extensions/sd-webui-additional-networks/models/lora/koreanDollLikeness_v15.safetensors

wget https://huggingface.co/Kanbara/doll-likeness-series/resolve/main/taiwanDollLikeness_v15.safetensors -O /content/stable-diffusion-webui/extensions/sd-webui-additional-networks/models/lora/taiwanDollLikeness_v15.safetensors

wget https://huggingface.co/rhine0613/fashionGirlv50/resolve/main/fashionGirl_v50.safetensors -O /content/stable-diffusion-webui/extensions/sd-webui-additional-networks/models/lora/fashionGirl_v50.safetensors

模型推荐

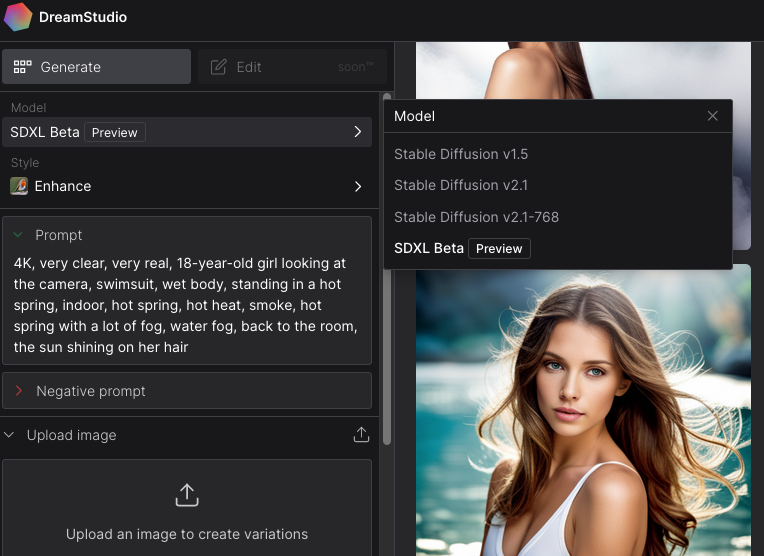

在画人物方面,这里推几个常用的模型:

- vae-ft-mse-840000-ema-pruned.ckpt

- chilloutmix(据说7g版更好?)

- 饭特稀

- 国风3(可配汉服)

- KoreanStyle2.5D

- counterfeit(动画)

Lora:

- japaneseDollLikeness

- koreanDollLikeness(必备)

- taiwanDollLikeness

- fashionGirl

- 20d

- 各种pov(你懂的)

经验分享

为什么画不出想要的效果,其实提示词差别不大,关键在于《主题》,合适的Lora更容易生成想要的内容。

以这张图为例,单用chilloutmix是比较难出这样的效果(尤其容貌)

这里还引用了koreanDollLikeness和taiwanDollLikeness两个Lora

根据提示词去找即可

提示词

提示词不是什么魔法咒语

应该灵活变通,而不是生搬硬套,建议花点时间看看上面写了什么,根据自己需要去增删。

非特殊内容,强烈建议在提示词的前方添加“solo”这样的关键词,避免出现多个人物——往往还是画坏的。

负面描述

个人倾向于越多越好,因为可以通用,有价值好好写个模板。

其中对肢体的描述尤为重要

missing arms, missing legs, extra arms, extra legs

多画点你就知道,最后NSFW灵活使用。

效率!!

AI画图终究还是开盲盒,可千万不要一个提示词画一次,看到好的又想换。

记住:单抽比不过十连

在不爆显存的情况下,调好整好尺寸,设置一个合适的《批次》

sdwebui会根据你设定的批次开始批量跑——12就是生成12张

并且,没有特殊情况下,绘图步数不要超过30。

采样方法尽可能使用DPM++ 2M Karras而不是SDE(很慢)

当然具体情况以模型作者建议参数为准。

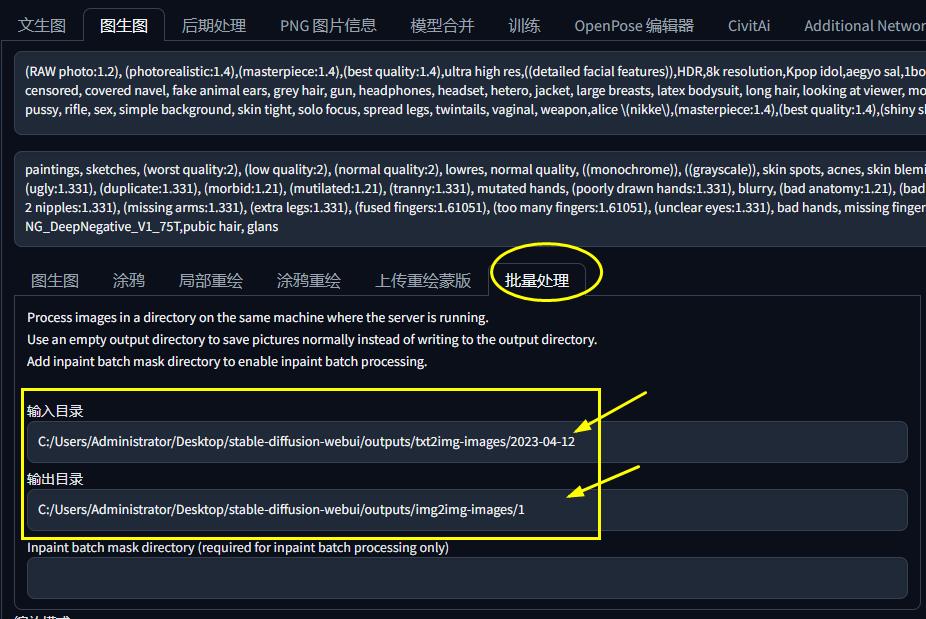

画完后使用图生图→图像批处理→配置好输入输出目录→调整参数即可批量出图

重绘幅度尽量不要超0.3

记得处理完后删掉输入文件夹内的临时图片。

默认输出的图片会生成一张jpg和png,jpg的exif会保留这张图的提示词,有需要可以保留。

完成这个流程后再进行下一轮跑图。

本文首发于:效率出图,我们是认真的 — HostLOC

您也可以联系文章作者本人进行修改,若内容侵权或非法,可以联系我们进行处理。

任何个人或组织,转载、发布本站文章到任何网站、书籍等各类媒体平台,必须在文末署名文章出处并链接到本站相应文章的URL地址。

本站文章如转载自其他网站,会在文末署名原文出处及原文URL的跳转链接,如有遗漏,烦请告知修正。

如若本站文章侵犯了原著者的合法权益,亦可联系我们进行处理。

你好昨天0

你好,可以再帮我看看吗? 我已经按照你的方法设定了,还是一样,wordpress后台的 Purge Varnish Cache 插件还是清除不到cache,依旧显示 the varnish control terminal is not responding at。谢谢 https://mjj.today/i/Srk2Tz https://mjj.today/i/Srkcoi你好4天前0

对,你说的没错,我配置的时候改了一些东西,现在我按照你的教学,可以启动了,网页可以缓存了,不过wordpress 清除cache 那个插件没用的,我输入本地回环地址127.0.0.1 :6082 ,再输入API key ,插件显示the varnish control terminal is not responding at 127.0.0.1:6082,就你图片那样,然后试一下点击清除cache 那里,他显示error,研究了一天,还是没有不行。你好5天前1

你好,为啥我按照你的方法,到第三部分,去到真正后源的服务器设定Varnish 部分,我填了真正后源的IP跟端口跟域名,然后重启 Varnish ,就出现这样了? 这是怎么回事? 谢谢 [Linux] AMH 7.1 https://amh.sh [varnish-6.6 start] ================================================== =========== [OK] varnish-6.6 is already installed. Could not delete 'vcl_boot.1713549650.959259/vgc.sym': No such file or directory Error: Message from VCC-compiler: VCL version declaration missing Update your VCL to Version 4 syntax, and add vcl 4.1; on the first line of the VCL files. ('/home/usrdata/varnish/default.conf' Line 1 Pos 1) ... #--- Running VCC-compiler failed, exited with 2 VCL compilation failedchu18天前0

很完善的教程‘hu23天前0

我用gmail EMAIL_SERVER="smtp://********@gmail.com:bpyfv*********[email protected]:587"叽喳23天前0

MAIL_SERVER="smtp://[email protected]:[email protected]:587" 大佬 这个使用outlook 或者gmail 是什么样子的格式? 邮寄已经开启smtp了hu24天前0

输入框的问题解决了,我没有设置反代,NEXTAUTH_URL改为域名+端口就好了hu24天前0

后面搭好了,但是不配置umami的话,进去之后保存按钮点不了,而且转发设置了都不通 又重新搭之后注册界面输入框没了